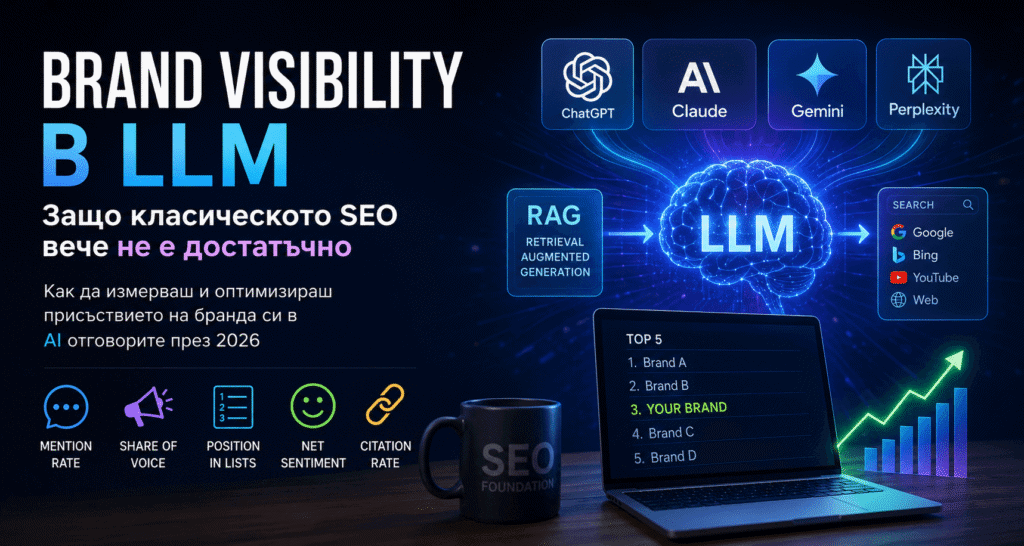

Класическото SEO мери позиции в търсачки, докато AI видимостта изисква оптимизация за цитиране в LLM отговори – фундаментално различен подход за достигане до потребители през 2026.

Ключови различия между SEO и AI Visibility

| Параметър | Класическо SEO | AI Visibility |

|---|---|---|

| Целева метрика | SERP позиции | Mention rate в LLM |

| Източник на трафик | Директни кликове | Цитирания в отговори |

| Оптимизация за | Ключови думи | Разговорни сценарии |

| Време за резултат | 90 дни | 45-90 дни |

| ROI хоризонт | 12 месеца | 24-36 месеца |

Как работят LLM-ите и защо това има значение

Съвременните модели (GPT-4, Claude Opus, Gemini) използват Transformer архитектура с до 5 трилиона параметри. Критичната разлика: LLM-ите не съхраняват знания като Google – всичко е статистически модел за предсказване на следващия токън.

Това създава два ефекта за бранд видимостта: стохастична природа (същият промпт дава различни отговори) и халюцинации срещу запаметяване. Затова всички модели използват RAG (Retrieval-Augmented Generation) – търсене в реални източници преди генериране на отговор.

RAG източници по модели

| LLM Модел | Search Engine | Специфики |

|---|---|---|

| ChatGPT | Класическо indexing | |

| Claude | Web grounding | |

| Perplexity | Собствен + Bing | Real-time search |

| Gemini | Google + YouTube | Директен достъп до транскрипти |

| DeepSeek | Chinese + Western | Fallback системи |

Пет метрики за AI Visibility

Mention Rate: Процент промпти със споменаване на бранда. Изчислява се от минимум 10-15 промпта за статистическа стабилност. Share of Voice: Споменавания на твоя бранд спрямо всички конкуренти. Може да имаш 50% mention rate, но само 10% share of voice ако конкурентите се споменават по-често. Позиция в списъците: Средна позиция в numbered lists или процент присъствие в топ 3. Net Sentiment Score: (Положителни – отрицателни) / общо споменавания. Измерва се с LLM анализ на ±200 токена около всяко споменаване. Честота на цитиране: Кои домейни цитира моделът в твоята ниша за планиране на external mentions.

5-стъпков план за повишаване на AI видимостта

- Техническо SEO до перфектно ниво – без класиране в Google за информационни заявки няма RAG присъствие

- External mentions на качествени домейни – редакторски споменавания в статии, не класически backlinks

- Присъствие в listicles – „Топ 10 X“ форматът е златна жила за LLM цитирания

- Тематично съдържание – обясни какво си, не само какво продаваш

- Разпръснати споменавания – инвестиция за бъдещи обучителни цикли с хоризонт 36 месеца

-

Времеви хоризонти за резултати

| Метрика | Време за промяна | Бележка |

|---|---|---|

| Citation Rate | 30-45 дни | Най-бърза реакция |

| Mention Rate | 60-90 дни | След action plan |

| Share of Voice | 90 дни | Изисква sustained effort |

| Model Weights | 24 месеца | Нов training cycle |

AI visibility е надстройка върху солидно техническо SEO, не заместител. Брандовете с успех комбинират безкомпромисно SEO изпълнение с систематични външни споменавания и правилни метрики за измерване.