„Трябва да се замислим за човешкия аспект на използването на ИИ в ежедневието ни и как той ще повлияе на начините, по които го възприемаме и взаимодействаме помежду си“, казва специалистът по комуникации Jeff Hancock.

От публичното си стартиране през ноември 2022г. ChatGPT привлича вниманието на целия свят, показвайки на милиони потребители по света необикновения потенциал на изкуствения интелект, който създава компетентно звучащи отговори на различни заявки – от практични до сюрреалистични.

Може да изготви мотивационни писма, да съчини стихове, да създаде съобщения за потребителите на приложения за запознанства, да привлече партньори и дори пише статии за новини.

Тези обещаващи приложения пораждат и етични дилеми. В свят, в който все повече доминират инструменти, задвижвани от изкуствен интелект, които могат да имитират човешките способности за естествен език, какво означава да бъдеш истински и автентичен?

Той се занимава с този въпрос и с въздействието на ИИ върху междуличностните отношения в своите изследвания.

Твърди, че ерата на теста на Тюринг е приключила: Сега ботовете звучат толкова реално, че за хората е невъзможно да правят разлика между човека и машините в разговорите, което създава огромни рискове за манипулация и измама в масов мащаб. Въпросът, който тревожи Хенкок и други учени е как тези инструменти могат да се използват за добро, а не за нанасяне на вреди.

Въпреки че вижда потенциала на ИИ да помогне на хората да вършат работата си по-ефективно, Ханкок е наясно и с подводните камъни. В крайна сметка, казва той, нашето предизвикателство ще бъде да разработим ИИ, който да подкрепя човешките цели и да обучим хората как най-добре да използват тези нови технологии по ефективен и етичен начин.

От няколко години насам Ханкок изследва как комуникацията с помощта на изкуствен интелект трансформира и потенциално подкопава междуличностните отношения.

В това интервю той обяснява някои от предизвикателствата, които поставят инструменти като ChatGPT и как те ще определят живота ни занапред.

@sumitsinvestmenttakes People have been messing around with Microsoft’s new AI-powered chatbot and it’s been losing its mind. #bing #microsoft #ai #chatgpt

♬ original sound – Sumit

Как мислите, че инструментите с изкуствен интелект като ChatGPT се вписват в живота на хората?

Подобно на калкулатора, който не е заменил нуждата от математически изчисления, от работа на каса или от счетоводство, мисля, че ще намерим начини да използваме комуникацията с помощта на ИИ като инструмент. Смятам, че колкото повече мислим за него като за асистент или инструмент, който е невероятно мощен, толкова повече можем да си представим как ще бъде полезен. Но е важно да се отбележи, че тези системи не са готови за включване и пускане в действие направо от работната маса.

ChatGPT се използва от милиони хора, много от които нямат никакво обучение или образование за това кога е етично да се използват тези системи или как да се гарантира, че те не причиняват вреда.

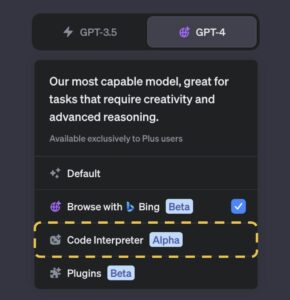

От техническа гледна точка системи като ChatGPT наистина са много по-добри от нещата, които сме имали в миналото, но все още има много проблеми за решаване. Понастоящем те не предоставят точна информация с много висока скорост. Най-добрите от тях дават полезна информация, която е точна в 50% или 70% от случаите, макар че това вероятно ще се промени с новите версии като предстоящата GPT4. Те могат да произвеждат неверни данни или да си измислят неща – това, което наричаме „халюцинации“. За да ги накарате да произведат нещо добро, може да е необходима много работа.

Има ли конкретни области, в които виждате възможност ChatGPT да помогне на хората да бъдат по-добри в работата си или да я вършат по-ефективно?

Мисля, че това ще доведе до един изцяло нов свят на комуникация. Наистина се чувствам като в преломен момент. Например, има огромен потенциал в началните нива на коучинга. Да приемем , че отлагате работата си или се нуждаете от помощ при водене на преговори, или имате някакъв проблем в работата си. Срещата с действителен консултант или коуч е трудна и може да бъде скъпа. Тези системи предлагат начини за получаване на достъп до такъв вид помощ, поне в началните етапи на работата по даден проблем. Мисля, че най-добрата комбинация ще бъде, когато ChatGPT може да подкрепи действителен коуч, който след това ще може да помогне на повече хора по-ефективно.

ChatGPT може да бъде полезен за извършване на част от подготвителната работа, която коучовете извършват, докато се опитват да разберат нуждите на клиентите си. Понякога това са стандартни въпроси, които система като ChatGPT може да бъде обучена да задава на клиента и след това да синтезира за коуча. Това би могло да освободи коуча, за да се ангажира по-задълбочено с този клиент или да помогне на повече клиенти.

Разбира се, все още не знаем как хората ще реагират на участието на ботове в този вид разговори. Работата, която свършихме преди няколко години, показа, че емоционалните, релационните и психологическите резултати от разговорите с ботове могат да бъдат подобни на тези с човек. В това има потенциал, но със сигурност ще е необходимо да се внимава при въвеждането на този вид системи в подобна комуникация.

Една от областите, които изучавате, е доверието и измамата. Как според вас ИИ влияе на начина, по който хората се доверяват един на друг?

Мисля, че ако машината ви помага да бъдете себе си, тогава ще можете да бъдете автентични. Системите на ИИ могат да бъдат оптимизирани за цял набор от неща и някои от тях могат да бъдат междуличностни. Можете да кажете: „Искам описание за онлайн запознанство. Това наистина би могло да помогне на човек, особено на хора, които изпитват тревога от общуването или не са много добри в изразяването на себе си.

Но за хората, които се опитват да използват тези описания като сигнали за това какъв е даден човек, нашият обичаен процес на формиране на впечатления се разпада, защото не вие сте се представили като много забавни и открити – това е направила машина вместо вас. Ще носим голяма отговорност за това как ще използваме тези инструменти. Мисля, че наистина става въпрос за това как ние като хора ще изберем да ги използваме.

Можем ли да се доверим на тези системи?

Има много технически въпроси, като например как е разработен изкуственият интелект. Широко разпространена е загрижеността, че тези системи разчитат на необективни данни за обучение. Но има и по-дълбоки философски въпроси, свързани със съзнанието и намерението. Какво означава една машина да бъде измамна? Тя може да лъже за това коя е и да говори за житейски опит, който не е имала, което е измамно. Но повечето определения за измама включват намерение да се заблуди някой. Ако системата няма такова намерение, тя заблуждава ли? Не знам. На този етап има повече въпроси, отколкото отговори.

Вие също така изучавате дезинформацията. Какво ви притеснява от това как изкуственият интелект може да се използва за нечисти цели?

Искам също да призная, че тук съществуват реални опасности за злоупотреба. Рене ДиРеста, мой колега и сътрудник в Станфордската обсерватория за интернет, публикува доклад, в който са изложени някои от основните начини, по които тези системи могат да бъдат заплаха за дезинформацията и възможните решения. Това има потенциала да промени и задълбочи проблема с дезинформацията и затова трябва да започнем да работим за решения сега.

Какво може да се направи, за да се удостовери автентичността на комуникацията?

През последната около година се появиха редица статии, които показват, че тези големи езикови модели и чатботове вече не могат да бъдат разграничени от човешките си партньори.

Така че как да се удостовери автентичността на комуникацията е голям въпрос. За да изглеждате автентични, можете да кажете: „Това е написано или частично написано от изкуствен интелект“. Ако го направите, ще бъдете честни, но проучванията показват, че хората могат да ви възприемат като по-малко искрени – излезе статия, според която ако се извините и посочите, че сте използвали ИИ, за да ви помогне да напишете извинението си, хората го възприемат като по-малко искрено. Тези въпроси, свързани с автентичността, измамата и доверието, ще бъдат изключително важни и се нуждаем от още много изследвания, които да ни помогнат да разберем как ИИ ще повлияе на начина, по който взаимодействаме с други хора.

Какво каза и Илон Мъск по въпроса

ChatGPT показва, че изкуственият интелект е станал невероятно развит и според технологичния милиардер Илон Мъск „всички трябва да се притесняваме от него“.

„Един от най-големите рискове за бъдещето на цивилизацията е изкуственият интелект“, заяви Мъск пред участниците в Световната правителствена среща на върха в Дубай, Обединените арабски емирства, малко след като спомена за разработването на ChatGPT.

„Той е както добър , така и лош , има големи, големи обещания, големи възможности“, каза Мъск. Но той подчерта, че „с това идва и голяма опасност“.

Мъск е съосновател на OpenAI, американски стартъп, който разработи ChatGPT – т.нар. генеративен инструмент за изкуствен интелект, който връща отговори, подобни на човешките, на потребителски запитвания.

ChatGPT е усъвършенствана форма на изкуствен интелект, използваща голям езиков модел, наречен GPT-3. Той е програмиран да разбира човешкия език и да генерира отговори въз основа на огромни масиви от данни.

Според Мъск ChatGPT „илюстрира на хората колко напреднал е станал изкуственият интелект“. „ИИ е напреднал от известно време. Той просто не е имал потребителски интерфейс, който да е достъпен за повечето хора“.

Докато автомобилите, самолетите и медицината трябва да се съобразяват с регулаторни стандарти за безопасност,за ИИ все още няма правила или разпоредби, които да държат развитието му под контрол, добави той.

„Честно казано, мисля, че трябва да регулираме безопасността на ИИ“, каза Мъск. „Мисля, че той всъщност представлява по-голям риск за обществото, отколкото автомобилите, самолетите или медицината.“

Регулирането „може да забави малко ИИ, но мисля, че това може да бъде и нещо добро“, добави Мъск.

Милиардерът отдавна предупреждава за опасностите от неограниченото развитие на ИИ. Веднъж той заяви, че изкуственият интелект е „много по-опасен“ от ядрените бойни глави.

Думите му имат по-голяма тежест днес, когато възходът на ChatGPT заплашва да преобърне пазара на труда с по-усъвършенствани, подобни на човешките писания.

Мъск напусна борда на OpenAI през 2018 г. и вече не притежава дял в компанията. „Първоначално тя беше създадена като организация с нестопанска цел с отворен код. Сега тя е със затворен код и с цел печалба. Аз нямам открит дял в OpenAI, не съм в борда и не я контролирам по никакъв начин“.

Част от причината за решението на Мъск да създаде OpenAI е, че „Google не обръщаше достатъчно внимание на безопасността на изкуствения интелект“, каза той.

Източник: Stanford University